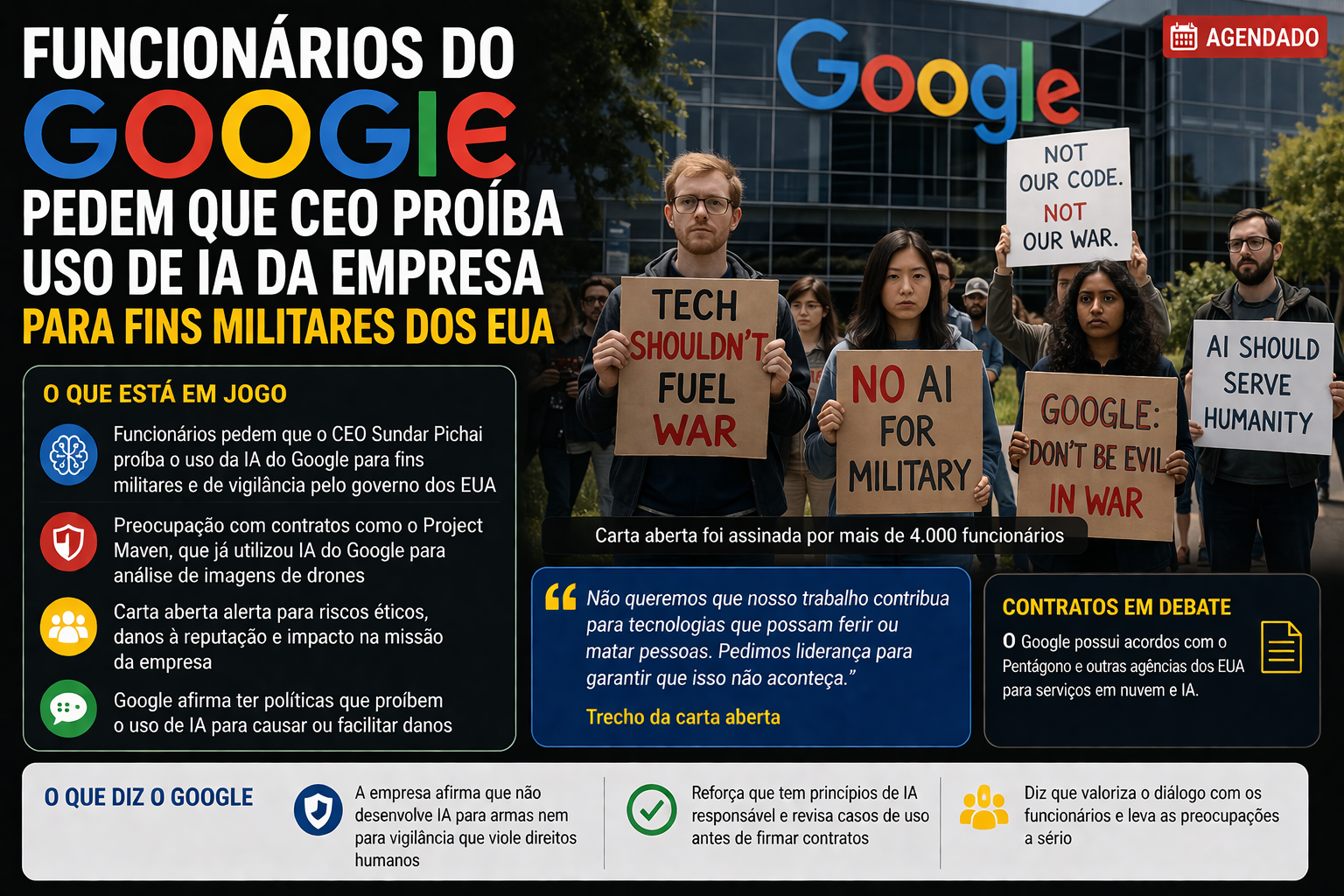

Mais de 500 funcionários do Google assinaram uma carta aberta enviada ao CEO da empresa, Sundar Pichai, solicitando que a companhia rejeite qualquer participação em projetos militares que envolvam o uso da inteligência artificial (IA). O documento expressa preocupação com a possibilidade de a tecnologia ser usada para fins considerados desumanos ou eticamente prejudiciais, como armas autônomas letais e vigilância em massa.

A carta foi protocolada nesta segunda-feira, 27 de abril de 2026, e traz um apelo claro: a tecnologia de IA desenvolvida pelo Google deve beneficiar a humanidade, e não ser aplicada em operações militares sigilosas que possam ocasionar danos sociais profundos, sem o consentimento dos próprios colaboradores ou da sociedade. “A única forma de garantir que o Google não seja associado a esse tipo de dano é rejeitar qualquer trabalho classificado”, afirmam os funcionários.

Contexto da pressão por ética no uso da IA militar

Este movimento surge em meio a uma crescente controvérsia e debate global sobre os limites éticos das tecnologias de IA, especialmente no que tange à sua aplicação em defesa e segurança nacional. A pressão aumenta após recentes conflitos entre o Pentágono dos EUA e empresas líderes em desenvolvimento de inteligência artificial, como a Anthropic, que se negou a colaborar com o governo americano em projetos militares sigilosos.

Empresas de tecnologia enfrentam, portanto, um dilema estratégico e reputacional: equilibrar as negociações lucrativas com governamentais e a responsabilidade social de não incentivar ou facilitar o uso da IA para armamentos autônomos ou vigilância estatal em larga escala.

O que muda para o leitor

Para o público em geral, esse debate evidencia como a tecnologia de ponta está cada vez mais integrada a contextos políticos e militares que podem impactar a segurança, os direitos civis e a privacidade. A mobilização dos funcionários do Google aponta para a preocupação crescente dentro do próprio setor tecnológico sobre as consequências do uso inadequado da IA.

Para trabalhadores na área de tecnologia, a carta representa um exemplo claro de ativismo interno em grandes corporações, influenciando diretamente decisões de gestão e ética corporativa. Para consumidores e investidores, o posicionamento da empresa pode afetar a reputação da marca e, consequentemente, sua valorização e investimentos futuros.

O que observar agora

- Resposta do CEO Sundar Pichai: Será determinante o posicionamento oficial de Pichai diante do pedido dos funcionários, especialmente se empresa seguirá negando ou limitando contratos com agências militares dos EUA que envolvam IA.

- Reação do mercado: Investidores e parceiros comerciais acompanharão de perto os impactos que decisões éticas e políticas da empresa poderão ter em sua competitividade e inovação tecnológica.

- Regulamentação da IA e defesa: A pressão para uma regulamentação global acerca do uso de IA em armamentos autônomos e vigilância está crescendo, o que pode afetar trabalhos futuros do Google e outras empresas do setor.

- Exemplos internacionais: Outras grandes companhias e governos poderão seguir tendência similar de limitar o envolvimento da IA em assuntos militares, especialmente após conflitos como o ocorrido entre Pentágono e Anthropic.

Entenda o impacto da decisão para a inteligência artificial e o mercado

A decisão do Google impacta diretamente o desenvolvimento e a aplicação da inteligência artificial no setor de defesa, que tem alto potencial financeiro e estratégico para empresas de tecnologia. Evitar o uso da IA para fins militares pode limitar contratos bilionários, mas alinha a empresa a uma postura ética valorizada por uma parte importante da sociedade e do mercado.

Além disso, a suspensão de acordos do tipo evita riscos legais e de imagem que podem vir a comprometer a confiança do consumidor e investidores, cada vez mais atentos às causas ambientais, sociais e de governança (ESG). A carta dos funcionários demonstra um movimento interno da empresa na tentativa de influenciar um mercado tecnológico onde o uso da IA militar ainda gera polêmica e insegurança.

Por outro lado, a negativa do Google pode estimular a concorrência no setor — empresas menos comprometidas com questões éticas podem assumir esse espaço, levando a possíveis consequências globais em termos de controle e usos indevidos da tecnologia.

Perguntas comuns sobre o uso de IA para fins militares

- Por que a IA em operações militares é controversa? O uso da IA pode resultar em armas autônomas que tomam decisões sem intervenção humana e em vigilância em massa que ameaça direitos civis.

- O que são armas autônomas letais? São sistemas armamentistas controlados por inteligência artificial capazes de operar, identificar e eliminar alvos sem supervisão humana direta.

- Como as empresas de tecnologia decidem se vão colaborar com os militares? Muitas avaliam riscos éticos, reputacionais e legais, enquanto outras negociam contratos bilionários, criando debates internos sobre responsabilidade social.

- Qual a influência dos funcionários nessas decisões? Além de pressão externa, mobilizações internas como a do Google mostram que colaboradores podem impactar políticas corporativas, especialmente em temas sensíveis como IA e ética.

- Existem leis específicas sobre IA para defesa? Ainda não há regulamentação internacional unificada; países estudam legislações para controlar e limitar o uso da IA em armamentos.

Em resumo, a carta dos funcionários do Google representa mais um capítulo das complexas decisões éticas que as grandes empresas de tecnologia enfrentam no contexto global atual, onde inovação e responsabilidade social caminham lado a lado e influenciam o futuro do mercado e da sociedade.